Yinelemeli sinir ağı

| Makine öğrenmesi ve veri madenciliği |

|---|

|

Yinelemeli sinir ağı, düğümler arası bağların zamansal bir dizi doğrultusunda yönlü çizge oluşturduğu bir yapay sinir ağı çeşididir. Yaygın olarak İngilizce kısaltması olan RNN (İngilizce: Recurrent neural network) olarak anılır. İleri beslemeli sinir ağından türetilen RNN yöntemi, bir iç durum belleği kullanarak değişik uzunluktaki dizileri işleyebilir.[1][2][3] Bu sayede yazı tanıma[4] ve konuşma tanıma[5][6] gibi problemlere uygulanabilir. Teorik olarak Turing makinesine denk (Turing-complete) olan yinelemeli sinir ağları, herhangi uzunluktaki bir girdiyi işleyebilen herhangi bir programı çalıştırabilir.[7]

Tarihçe[değiştir | kaynağı değiştir]

Yinelemeli sinir ağları David Rumelhart'ın 1986 yılındaki çalışmasına dayanır.[8] Hopfield ağı denen özel bir RNN türü de John Hopfield tarafından 1982 yılında geliştirilmiştir. 1993 yılında, bir RNN çalışması 1000'den fazla katman gerektiren bir “çok derin öğrenme” görevini başarmıştır.[9] Long short-term memory (LSTM) ağları Hochreiter ve Schmidhuber tarafından 1997 yılında geliştirilmiş ve çeşitli uygulama alanlarında en iyi performansları kaydetmiştir.[10]

Çeşitleri[değiştir | kaynağı değiştir]

Birçok farklı RNN mimarisi vardır.

Tam yinelemeli[değiştir | kaynağı değiştir]

Tam yinelemeli sinir ağlarında tüm nöronların çıktısı tüm nöronların girdisine bağlanır. En genel RNN mimarisi budur, çünkü diğer tüm mimariler, buradaki bazı bağların ağırlıkları sıfırlanarak elde edilebilir. RNN'ler iki farklı biçimde gösterilir: kapalı biçimde, özyineleme bağlantıları düğümlerin kendilerinin bir sonraki adımdaki durumuna olan bağlantılarıdır; açılmış biçimde, düğümlerin her zaman adımındaki durumları ayrı ayrı gösterilir.

Geçitli yineleme birimi[değiştir | kaynağı değiştir]

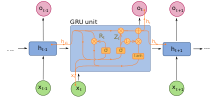

Geçitli yineleme birimi (İngilizce: gated recurrent unit, GRU) 2014 yılında önerilmiş bir yinelemeli ağ birimidir. Bu birimler, nöronlar arasındaki geçişi düzenleyen bir takım öğeler barındırır.[11][12] LSTM'e benzer şekilde unutma kapısı bulunur, ancak GRU yapıları genellikle daha basittir.[13] Polifonik müzik ve konuşma sinyali modelleme gibi işlerde LSTM'e benzer bir başarıyla çalışır.[14]

Kaynakça[değiştir | kaynağı değiştir]

- ^ Dupond, Samuel (2019). "A thorough review on the current advance of neural network structures". Annual Reviews in Control. Cilt 14. ss. 200-230. 3 Haziran 2020 tarihinde kaynağından arşivlendi. Erişim tarihi: 3 Kasım 2021.

- ^ Abiodun, Oludare Isaac; Jantan, Aman; Omolara, Abiodun Esther; Dada, Kemi Victoria; Mohamed, Nachaat Abdelatif; Arshad, Humaira (1 Kasım 2018). "State-of-the-art in artificial neural network applications: A survey". Heliyon (İngilizce). 4 (11). ss. e00938. doi:10.1016/j.heliyon.2018.e00938

. ISSN 2405-8440. PMC 6260436 $2. PMID 30519653.

. ISSN 2405-8440. PMC 6260436 $2. PMID 30519653.

- ^ Tealab, Ahmed (1 Aralık 2018). "Time series forecasting using artificial neural networks methodologies: A systematic review". Future Computing and Informatics Journal (İngilizce). 3 (2). ss. 334-340. doi:10.1016/j.fcij.2018.10.003

. ISSN 2314-7288. 29 Kasım 2021 tarihinde kaynağından arşivlendi. Erişim tarihi: 3 Kasım 2021.

. ISSN 2314-7288. 29 Kasım 2021 tarihinde kaynağından arşivlendi. Erişim tarihi: 3 Kasım 2021.

- ^ Graves, Alex; Liwicki, Marcus; Fernandez, Santiago; Bertolami, Roman; Bunke, Horst; Schmidhuber, Jürgen (2009). "A Novel Connectionist System for Improved Unconstrained Handwriting Recognition" (PDF). IEEE Transactions on Pattern Analysis and Machine Intelligence. 31 (5). ss. 855-868. CiteSeerX 10.1.1.139.4502 $2. doi:10.1109/tpami.2008.137. PMID 19299860. 2 Ocak 2014 tarihinde kaynağından arşivlendi (PDF). Erişim tarihi: 3 Kasım 2021.

- ^ Sak, Haşim; Senior, Andrew; Beaufays, Françoise (2014). "Long Short-Term Memory recurrent neural network architectures for large scale acoustic modeling" (PDF). 6 Eylül 2015 tarihinde kaynağından (PDF) arşivlendi.

- ^ Li, Xiangang; Wu, Xihong (15 Ekim 2014). "Constructing Long Short-Term Memory based Deep Recurrent Neural Networks for Large Vocabulary Speech Recognition". arXiv:1410.4281 $2.

- ^ Hyötyniemi, Heikki (1996). "Turing machines are recurrent neural networks". Proceedings of STeP '96/Publications of the Finnish Artificial Intelligence Society: 13-24.

- ^ Williams, Ronald J.; Hinton, Geoffrey E.; Rumelhart, David E. (October 1986). "Learning representations by back-propagating errors". Nature. 323 (6088): 533-536. Bibcode:1986Natur.323..533R. doi:10.1038/323533a0. ISSN 1476-4687.

- ^ Schmidhuber, Jürgen (1993). Habilitation thesis: System modeling and optimization (PDF). s. 150.[ölü/kırık bağlantı]

- ^ Hochreiter, Sepp; Schmidhuber, Jürgen (1 Kasım 1997). "Long Short-Term Memory". Neural Computation. 9 (8): 1735-1780. doi:10.1162/neco.1997.9.8.1735. PMID 9377276.

- ^ Heck, Joel; Salem, Fathi M. (12 Ocak 2017). "Simplified Minimal Gated Unit Variations for Recurrent Neural Networks". arXiv:1701.03452 $2.

- ^ Dey, Rahul; Salem, Fathi M. (20 Ocak 2017). "Gate-Variants of Gated Recurrent Unit (GRU) Neural Networks". arXiv:1701.05923 $2.

- ^ Britz, Denny (27 Ekim 2015). "Recurrent Neural Network Tutorial, Part 4 – Implementing a GRU/LSTM RNN with Python and Theano – WildML". Wildml.com. 27 Ekim 2015 tarihinde kaynağından arşivlendi. Erişim tarihi: 18 Mayıs 2016.

- ^ Chung, Junyoung; Gulcehre, Caglar; Cho, KyungHyun; Bengio, Yoshua (2014). "Empirical Evaluation of Gated Recurrent Neural Networks on Sequence Modeling". arXiv:1412.3555 $2.